Reator 2 | #25 | Voz deepfake

Está cada vez mais difícil identificar o verdadeiro e o falso

Há tempos que golpistas fazem uso de ligações telefônicas, se passando por atendentes de telemarketing, parentes ou conhecidos, pra tentar aplicar algum golpe e tirar alguma vantagem financeira.

Teve um período, há alguns anos, que essa prática era uma verdadeira praga. Quase todo mundo recebia ligações de golpistas. Uma dessas ligações eu registrei e transformei em um episódio de podcast. Foi uma diversão fazer o marginal seguir na ilusão de que estava me convencendo.

A voz tem milhares de variáveis e assinaturas únicas. Um ouvido atento sabe identificar algumas peculiaridades individuais e consegue diferenciar o que é imitação do que é autêntico.

Na verdade, conseguia.

A popularização da Inteligência Artificial (IA) generativa melhorou e muito os resultados de diversas ferramentas de criação, principalmente as usadas na geração de áudios falsos.

O problema é que cada vez menos as pessoas conseguem distinguir entre o que é um deepfake de voz e uma fala humana verdadeira, segundo estudo publicado na revista científica PLoS ONE essa semana.

O termo “deepfake” é usado quando queremos indicar criações em vídeo, áudio ou foto que tenham sido criadas para parecer realistas, mas feitas com inteligência artificial. O objetivo desse tipo de criação é que a modificação seja tão imperceptível que pareça real.

No estudo, pesquisadores da University College London (UCL), na Inglaterra, testaram a capacidade de 529 pessoas em identificar o que era uma voz real do que era um deepfake sonoro. Em mais de um quarto dos casos (27%), os voluntários se confundiram entre o que era real e inventado pelo algoritmo da IA. Os áudios foram testados com pessoas que entendiam o inglês. Também teve experimentos em mandarim. Esse experimento é o primeiro a avaliar a capacidade humana de detectar a fala gerada artificialmente em um idioma diferente do inglês.

Os pesquisadores perceberam que os participantes do experimento só conseguiram identificar o deepfake de voz em 73% das ocasiões. Além disso, mesmo após esses participantes receberem informações e orientações técnicas sobre como reconhecer as falas falsas, ainda assim o índice de acerto variou pouco.

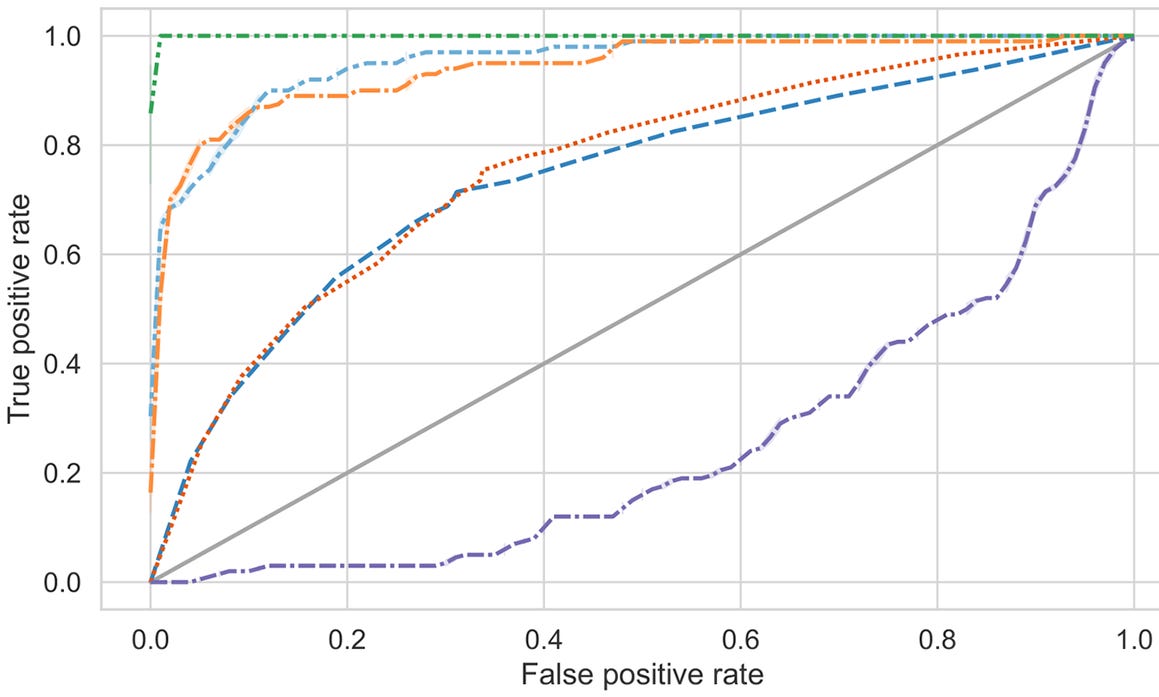

No gráfico, em verde, é a efetividade de acerto de um detector automatizado. 100% de acerto para ambos os idiomas. Os demais traços são os desempenhos humanos, que apesar de um percentual de acerto bom, em alguns cenários, começa a se distanciar da capacidade alta de identificação.

O próximo passo para os pesquisadores é desenvolver melhores detectores de fala automatizados como parte dos esforços contínuos para criar recursos tecnológicos pra combater ameaças por meio de áudio geradas artificialmente.

O temor maior é que essa tecnologia possa ser usada por criminosos e causar prejuízos sem igual e com isso a gente vai precisar conviver e se precaver.

🌊 Rios Voadores

Será que a perícia forense está preparada para as deepfakes?

Cientistas ensinam como reconhecer um deepfake em áudio.

🔵 Texto feito por Denys Cruz, mestre em ensino tecnológico, especialista em marketing e pesquisador em Manaus, Amazonas. É também analista técnico do Sebrae Amazonas.